Todos os caminhos levam ao AI RAN

AI RAN está se movendo para a quadra central. Embora as operadoras não tenham mudado fundamentalmente a forma como pensam sobre seus roteiros de RAN – abertura, inteligência, automação e virtualização continuam sendo os pilares principais das plataformas RAN de próxima geração – a visibilidade e a adoção dessas tecnologias variam significativamente. Na fase inicial do 5G, Open RAN e vRAN dominaram a conversa. Hoje, AI RAN é o objeto brilhante.

Eventos como o MWC2026 Barcelona e o Nvidia GTC reforçaram a mensagem que comunicamos há algum tempo, nomeadamente que o AI RAN já está a acontecer. Ao mesmo tempo, a conversa sobre GPU está mudando. Olhando para o futuro, espera-se que a AI RAN tenha ampla adoção em toda a RAN na segunda metade do ciclo 5G e desde o início do 6G.

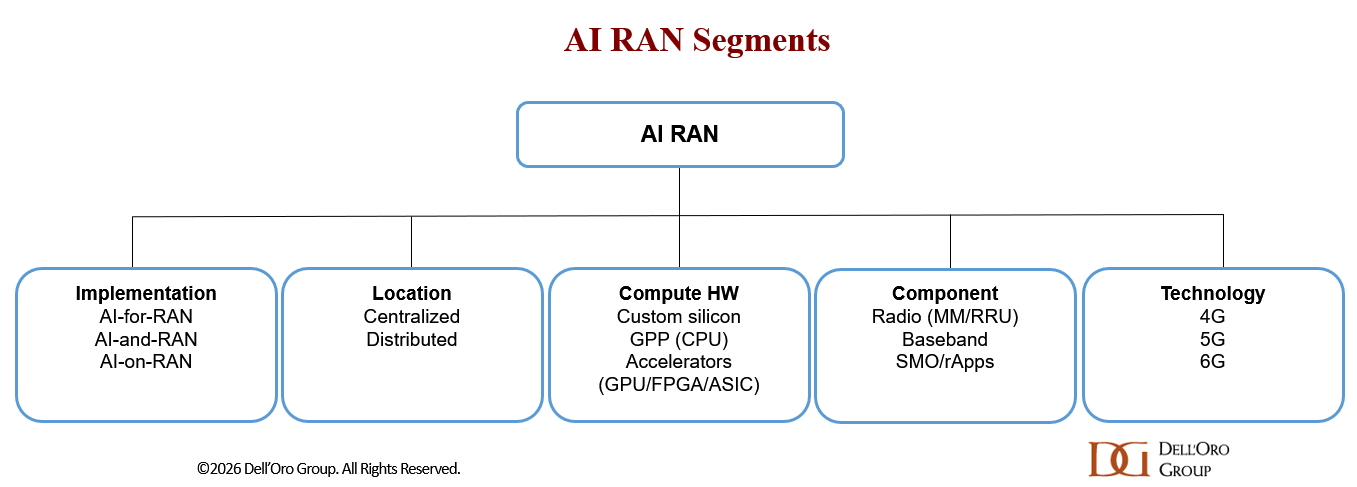

Todos os caminhos levam a uma maior adoção de AI RAN. Surgirão diferenças entre modelos de implantação, arquiteturas de computação, escolhas de hardware, divisões funcionais e tecnologias subjacentes.

Atualmente, a maior parte do mercado de AI RAN é impulsionada por soluções distribuídas de IA para RAN focadas na melhoria do desempenho e da eficiência, muitas vezes aproveitando a infraestrutura 5G existente. Fornecedores como Huawei e ZTE enviaram coletivamente mais de 0,6 milhão de placas/plug-ins habilitados para IA, ressaltando que AI RAN já está acontecendo em escala.

Uma das principais conclusões do MWC Barcelona é que quase todos os roteiros de RAN — de fornecedores grandes e pequenos — agora incorporam recursos de AI RAN em toda a pilha de RAN, com foco em IA para RAN. E não se trata apenas da banda base: os fornecedores agora estão trazendo inteligência para todas as camadas RAN, incluindo os rádios. O lançamento pela Ericsson de dez rádios prontos para IA com silício interno e aceleradores de rede neural é um exemplo disso. A questão não é mais se AI RAN e AI-RAN acontecerão, mas sim como, o quê, onde e quando.

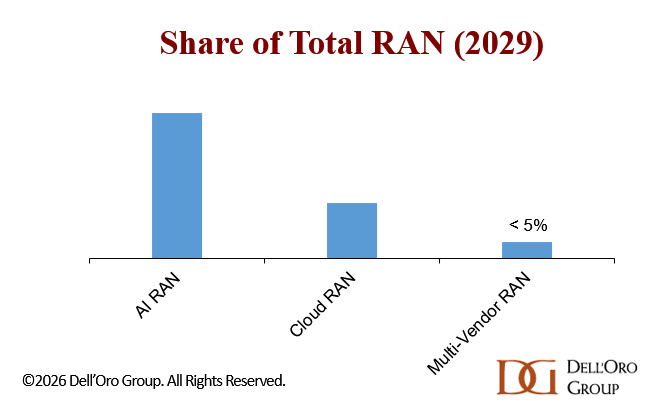

A visão de longo prazo da Dell’Oro sobre a RAN da próxima geração permaneceu praticamente intacta. Eventos como MWC 2026 e NVIDIA GTC pouco fizeram para alterar a trajetória subjacente. A probabilidade de que AI RAN, Cloud RAN e RAN de vários fornecedores desempenhem papéis importantes na segunda metade do 5G e no início da era 6G permanece alta, moderada e baixa, respectivamente. De acordo com nosso último atualização de previsãoespera-se que a AI RAN ultrapasse US$ 10 bilhões e represente cerca de um terço do mercado total de RAN até 2029 (esta não é uma receita nova).

Dentro do domínio AI RAN, as perspectivas para GPU-RAN (e AI-e-RAN) estão melhorando – ainda pequenas, mas não mais desprezíveis. Esta mudança reflete tanto as baixas expectativas iniciais como uma mudança gradual no sentimento. A conversa está passando do ceticismo absoluto para uma curiosidade cautelosa. Grande parte desse impulso está sendo impulsionado pelo esforço contínuo da NVIDIA e por sua visão de que os cerca de 10 milhões de macro sites do mundo poderiam evoluir para mais do que apenas estações base. Como disse Jensen Huang durante sua palestra no GTC: “Essa estação base… vai se tornar uma plataforma de infraestrutura de IA.”

O progresso inicial das operadoras – da T-Mobile, SoftBank e Indosat – combinado com a recente reiteração do seu roteiro AI-RAN pela Nokia, está reforçando essa mudança. Enquanto isso, a Samsung e a Fujitsu estão explorando se as GPUs poderiam fazer sentido para diversificar suas plataformas de computação.

Parte do interesse renovado em AI RAN – e especificamente em GPU RAN – decorre de uma constatação mais ampla: a mudança tecnológica está acelerando em um ritmo muito mais rápido do que durante a transição de 4G para 5G. Esta mudança está a remodelar a forma como a indústria vê o papel das redes móveis, a distribuição da inferência de IA e os compromissos entre arquiteturas baseadas em hardware e arquiteturas definidas por software.

Ao mesmo tempo, a “IA física” está a tornar-se mais tangível. Conceitos que antes pareciam ficção científica – como robôs ajudando a cozinhar ou acompanhando as crianças até a escola – são agora cada vez mais plausíveis no curto prazo.

Dito isto, as operadoras permanecem cautelosas por enquanto em relação à GPU RAN e à distribuição de inferência de IA de base ampla, mesmo que o ceticismo diminua gradualmente à medida que o ecossistema amadurece. As restrições são estruturais. As implantações de RAN operam sob orçamentos de energia rígidos, controles rígidos de custos e requisitos de grande escala. Esses fatores tornam difícil justificar a implantação de computação com uso intensivo de energia em cada estação celular.

Portanto, persistem preocupações sobre a lacuna de desempenho por watt entre GPUs e silício personalizado, bem como sobre a praticidade e a necessidade de oferecer suporte a cargas de trabalho que não sejam de telecomunicações em locais D-RAN e C-RAN, especialmente em implantações D-RAN. Por exemplo, a demonstração de assistência ao robô SoftBank/Ericsson no MWC operou com requisitos de latência de cerca de 100 ms, o que permite inferência centralizada de IA, com recursos de computação localizados em um data center usando a função User Plane.

Em outras palavras, a AI RAN está passando do exagero para a realidade. Embora as compensações entre as necessidades de distribuição de inferência de IA, flexibilidade, desempenho, eficiência energética, TCO e TTM moldarão os caminhos de adoção no curto e no longo prazo, a direção geral é clara: a IA se tornará parte integrante de todas as camadas da RAN.

As projeções de caso base sugerem que a RAN não-GPU dominará a AI RAN durante o período de previsão, refletindo tanto a capacidade de atualizar a infraestrutura existente, as restrições no local da célula e a necessidade de locação multiuso. Isso sugere que a NVIDIA ainda enfrenta um desafio significativo se pretende se posicionar não apenas como o “rei da inferência”, mas também como o “rei da AI RAN”.

Ao mesmo tempo, a conversa está evoluindo claramente. As operadoras não estão mais perguntando por que as GPUs podem ser relevantes, mas sim onde e quando elas fazem sentido. Se a NVIDIA conseguir expandir o papel da RAN – de uma camada de conectividade de propósito único para uma plataforma de IA distribuída – a oportunidade de longo prazo poderá ser significativamente maior do que o que está atualmente refletido em nossas premissas de caso base. Como sugere a Lei de Amara, o risco pode não ser sobrestimar o impacto a curto prazo da AI RAN, mas subestimar a procura de inteligência mais distribuída a longo prazo.

A postagem Todos os caminhos levam ao AI RAN apareceu primeiro em Grupo Dell’Oro.

.png?w=1920&resize=1920,1075&ssl=1)

Post Comment